法律推理的人工智能建模 基础软件开发的新前沿

随着人工智能技术的迅猛发展,其触角已延伸至法律这一古老而严谨的领域。法律推理的人工智能建模,正成为人工智能基础软件开发中一个充满挑战与机遇的前沿方向。它旨在将法律条文、判例、逻辑和人类经验转化为计算机可理解和处理的形式,从而辅助或模拟人类的法律推理过程。

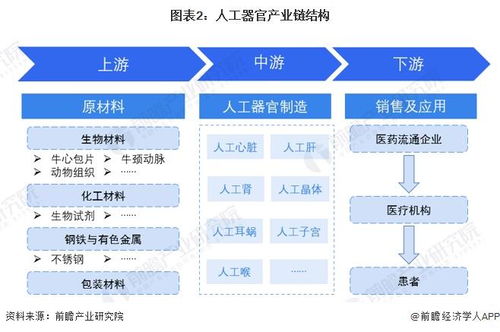

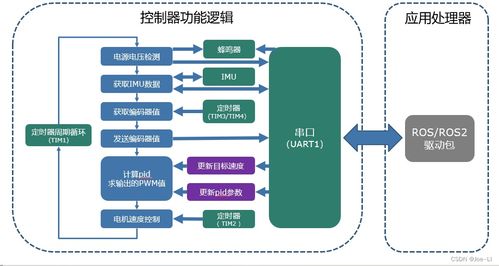

法律推理的核心,是从已知的法律规则和事实出发,通过演绎、归纳、类比等逻辑方法,得出特定法律结论的过程。人工智能建模这一过程,首要任务是知识的表示与获取。这需要将浩如烟海、语言精妙且充满解释空间的法律条文、司法解释、历史判例等,结构化地转化为知识图谱、逻辑规则或向量表示。自然语言处理技术的深度应用,特别是对法律文本的精准语义解析和关系抽取,是构建高质量法律知识库的基础。

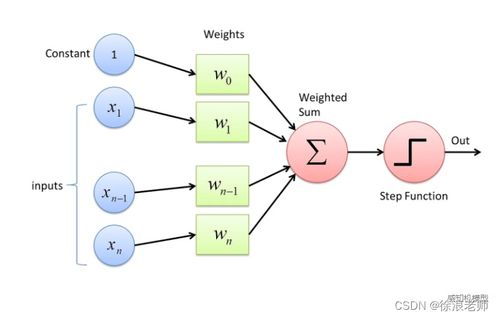

在法律知识表示的基础上,推理模型的构建是技术核心。传统的基于规则的专家系统方法,通过“IF-THEN”形式的法律规则链进行逻辑推演,具有可解释性强的优点,但面对法律的开放性和模糊性时显得僵化。以机器学习,尤其是深度学习为代表的数据驱动方法异军突起。通过对海量裁判文书进行训练,模型可以学习到事实特征与判决结果之间的复杂关联,进行预测性分析,例如预测案件结果、刑期或赔偿金额。这类“黑箱”模型常因缺乏透明的推理链条而难以获得法律从业者的完全信任。

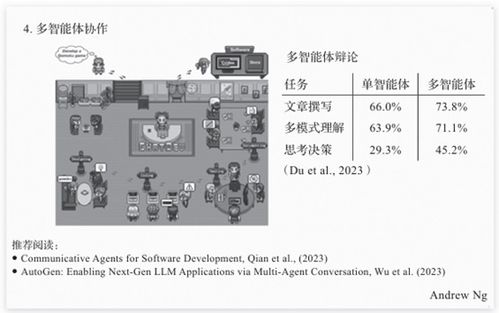

因此,当前最前沿的探索方向是融合路径:将符号主义(规则、知识图谱)与连接主义(神经网络)相结合,构建混合增强智能系统。例如,利用知识图谱为神经网络提供结构化背景知识,约束其推理方向;或让神经网络学习从事实到法律概念的映射,再由符号系统进行严谨的逻辑推演。这种结合旨在同时获得数据驱动的强大学习能力和符号系统的可解释性、可追溯性。

法律推理AI的基础软件开发,面临着独特的技术与伦理挑战。技术上,法律语言的歧义性、案件事实的复杂性、法律价值的权衡(如公正与效率),都对模型的泛化能力和鲁棒性提出了极高要求。伦理与合规上,模型必须避免放大历史数据中可能存在的社会偏见,确保公平性;其决策过程需要满足可解释、可审计的要求,以符合法律程序正义的原则;AI应定位为“辅助工具”,司法裁判的责任主体必须是人。

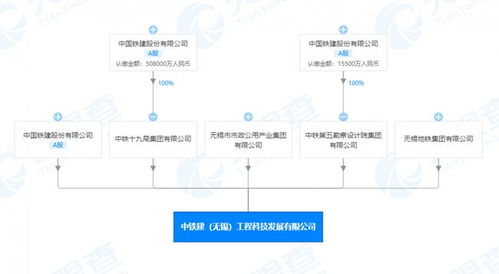

法律推理AI的基础软件平台,将可能整合法律知识管理、案例检索与分析、法律文书生成、合规审查、诉讼结果预测等多个模块,成为法律从业者的“智能大脑”。这不仅将提升法律服务的效率与普惠性,也可能促使我们更深入地反思法律推理的本质。开发此类软件,需要计算机科学家、法律专家、逻辑学家和伦理学者的深度跨界合作,共同绘制这场深刻变革的技术蓝图与规则边界。

如若转载,请注明出处:http://www.zkkiss.com/product/37.html

更新时间:2026-05-30 07:21:02