人工智能发展的背后 跌宕起伏近百年与基础软件的崛起

人工智能(AI)的发展史,是一部交织着梦想、挫折与突破的百年史诗。从最初的概念萌芽到如今的广泛应用,其背后不仅承载着科学家的智慧与坚持,更离不开基础软件这一“看不见的基石”的持续演进。这段跌宕起伏的历程,揭示了技术革命的复杂本质。

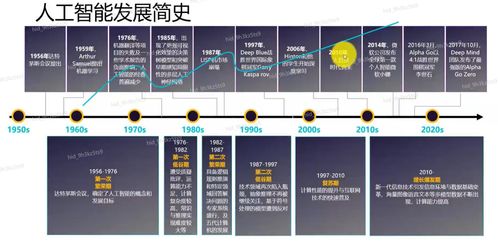

故事的起点可追溯至20世纪中叶。1956年的达特茅斯会议正式提出“人工智能”一词,点燃了第一波乐观浪潮。早期研究者们相信,用符号和规则模拟人类思维,就能快速实现智能机器。受限于计算能力与数据规模,这些基于逻辑推理的系统很快遭遇瓶颈,陷入了第一次“AI寒冬”。人们开始意识到,智能的复杂性远超预期。

转机出现在20世纪80年代。随着专家系统的兴起,AI找到了商业应用的突破口,基础软件如Lisp等专用语言和早期知识表示工具开始发展。但专家系统同样存在局限性,无法处理不确定性问题,导致热潮再次冷却。这一时期,基础软件的积累虽缓慢,却为后续变革埋下了种子。

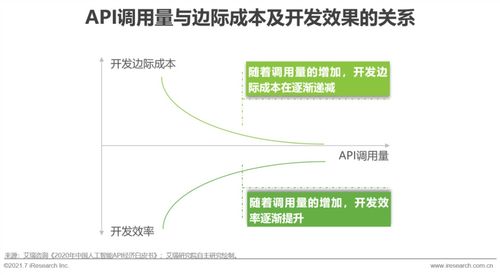

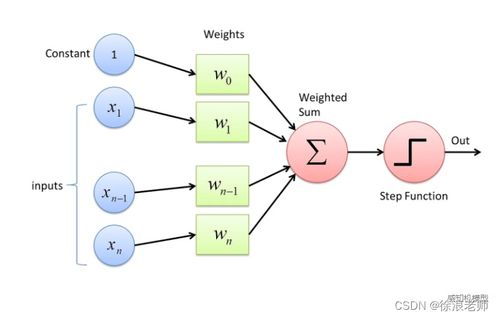

真正的革命性突破源于21世纪初。大数据、算力提升(尤其是GPU的广泛应用)以及机器学习算法的革新(如深度学习),共同推动了AI的复兴。而这一切的核心驱动力,正是基础软件的成熟与普及。以TensorFlow、PyTorch为代表的深度学习框架,将复杂的数学模型封装为易用的接口,大幅降低了开发门槛;开源社区如GitHub促进了全球协作,加速了算法迭代;云计算平台(如AWS、Azure)提供了弹性的计算资源,使得训练大规模模型成为可能。这些基础软件构成了AI生态系统的“操作系统”,让研究者与开发者能专注于创新而非底层细节。

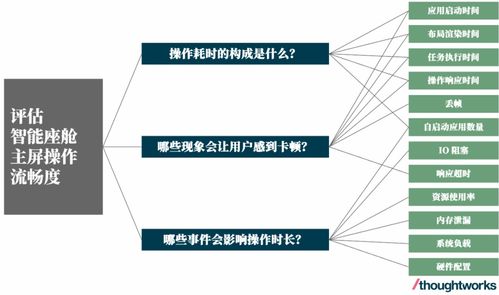

发展并非一帆风顺。AI的伦理挑战、数据偏见、能耗问题以及“黑箱”决策的不可解释性,不断引发社会担忧。基础软件也面临考验:如何确保安全性、公平性和可追溯性?开源协议与商业化的平衡如何把握?这些难题促使基础软件向更透明、更稳健的方向演进,例如引入模型可解释性工具和联邦学习框架。

AI基础软件正朝着标准化、自动化和民主化迈进。AutoML技术试图自动化模型设计;边缘计算推动轻量级框架发展;跨平台工具链致力于打破数据孤岛。近一个世纪的跌宕起伏告诉我们,AI的进步从来不是单点突破,而是算法、硬件与基础软件协同进化的结果。正如操作系统之于计算机,基础软件已成为AI时代的“新基建”,它默默支撑着每一次智能跃迁,并将继续在伦理与创新的平衡中,书写下一个百年篇章。

如若转载,请注明出处:http://www.zkkiss.com/product/66.html

更新时间:2026-05-24 19:45:18